英伟达CEO黄仁勋上周在Lex Fridman的播客中直言不讳地表示:“我认为我们已经实现了AGI(通用人工智能)。”两天后,人工智能研究中最严格的测试发布了其最新的人工通用智能基准——每个前沿模型的得分都低于1%。

ARC Prize基金会本周发布了ARC-AGI-3,结果令人震惊。谷歌的Gemini 3.1 Pro以0.37%的得分领先。OpenAI的GPT-5.4得分为0.26%。Anthropic的Claude Opus 4.6得分为0.25%,而xAI的Grok-4.20得分为零。与此同时,人类解决了100%的环境问题。

这不是一个琐事测试或编码考试,甚至不是超难的博士级问题。ARC-AGI-3与人工智能行业以前面临的任何测试都完全不同。

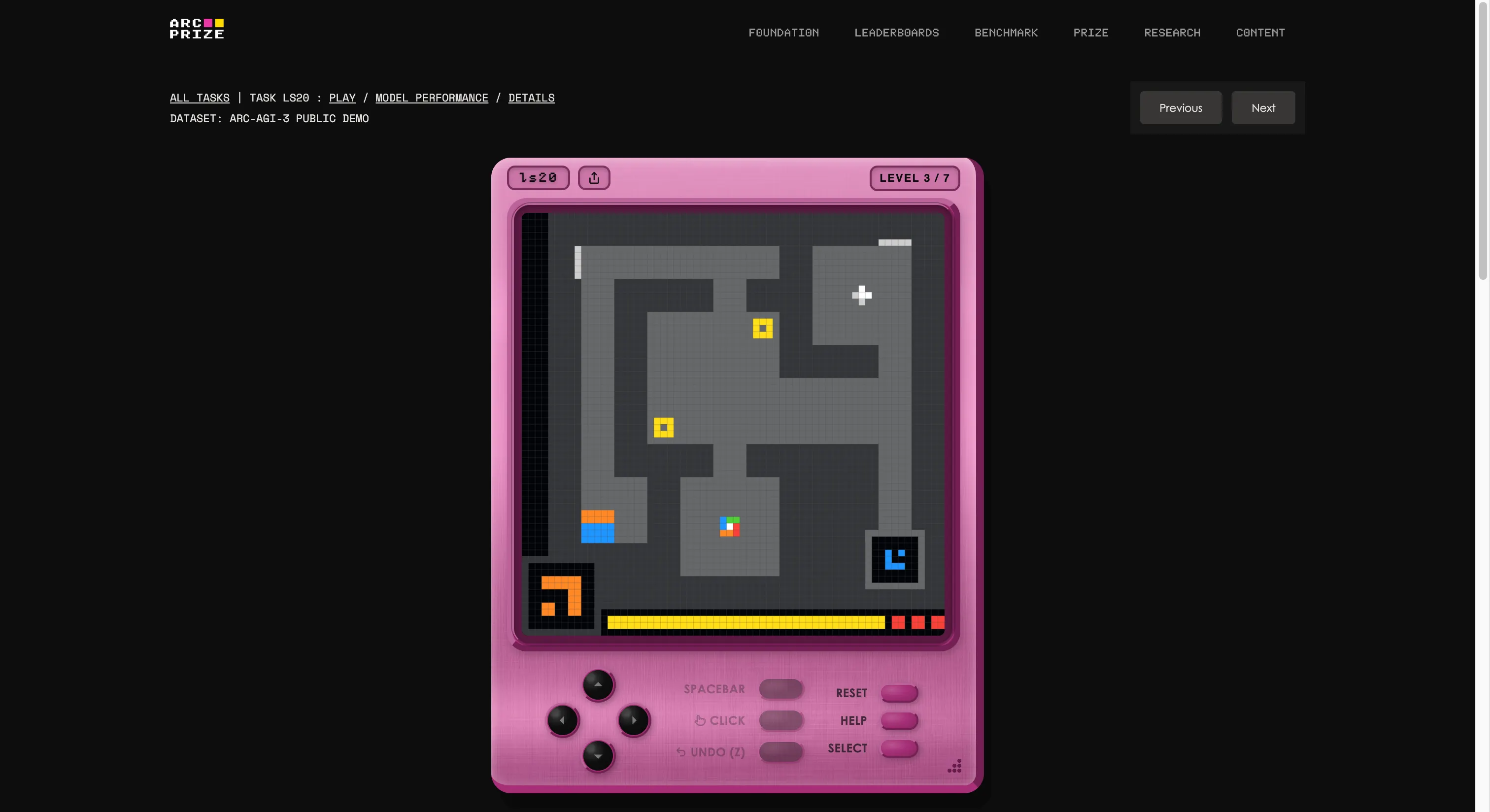

该基准由François Chollet和Mike Knoop的基金会构建,他们建立了一个内部游戏工作室,从头创建了135个原创交互环境。其理念是将AI智能体放入一个陌生的游戏般世界中,没有任何指令、没有任何既定目标,也没有规则描述。智能体必须探索、弄清楚应该做什么、制定计划并执行。

如果这听起来像是任何五岁孩子都能做的事情,那么你开始理解问题了。如果你想看看自己是否比AI更好,你可以通过点击此链接玩测试中出现的相同游戏。我们尝试了一个;起初很奇怪,但几秒钟后,你就能轻松掌握。

这也是“G”在AGI中代表什么的最清晰例子。当你泛化时,你能够创造新知识(一个奇怪的游戏如何工作)而无需事先接受训练。

ARC的先前版本测试静态视觉谜题——显示一个模式,预测下一个。起初很难。然后实验室投入计算能力和训练,直到基准实际上失效。2019年推出的ARC-AGI-1屈服于测试时训练和推理模型。ARC-AGI-2持续了大约一年,直到Gemini 3.1 Pro达到77.1%。实验室非常擅长饱和他们可以训练的基准。

版本3专门设计来防止这种情况。在135个环境中,有110个保持私密——55个半私密用于API测试,55个完全锁定用于竞赛——没有数据集可以记忆。你无法通过你从未见过的新颖游戏逻辑来暴力破解。

评分也不是通过/失败。ARC-AGI-3使用基金会所称的RHAE——相对人类行动效率。基线是第二好的人类首次表现。一个AI采取的行动是人类十倍,在该级别得分为1%,而不是10%。该公式对低效率进行平方惩罚。四处游荡、回溯和猜测答案的方式会受到严厉惩罚。

在为期一个月的开发者预览中,最好的AI智能体得分为12.58%。通过官方API测试的前沿LLM,没有自定义工具,无法突破1%。普通人类解决了所有135个环境,没有事先训练,也没有指令。如果这是标准,那么当前的模型群还没有达到。

这里有一个真正的方法论辩论。ARC的报告称,杜克大学构建的自定义工具将Claude Opus 4.6在单个环境变体TR87上的得分从0.25%推高到97.1%。这并不意味着Claude在ARC-AGI-3总体上得分为97.1%;其官方基准得分仍为0.25%,但这一变化仍值得注意。

官方基准向智能体提供JSON代码,而不是视觉信息。这要么是方法论缺陷,要么是证明当今模型在处理人类友好信息方面比处理原始结构化数据更好。Chollet的基金会已经承认了这一辩论,但没有改变格式。

“框架内容感知和API格式不是前沿模型在ARC-AGI-3上性能的限制因素,”论文写道。换句话说,他们似乎拒绝了模型失败是因为它们“看不到”任务的观点,而是认为感知已经足够——真正的差距在于推理和泛化。

AGI现实检查

AGI的现实检查在一个炒作机器全速运转的一周到来。除了黄仁勋的评论,Arm将其新的数据中心芯片命名为“AGI CPU”。OpenAI的Sam Altman表示他们已经“基本上构建了AGI”,微软已经在营销一个专注于构建ASI的实验室:AGI实现后的进化。这个词似乎被拉伸到意味着任何商业上方便的东西。

Chollet的立场更简单。如果一个没有指令的普通人能做到,而你的系统不能,那么你就没有AGI——你有一个非常昂贵的自动完成工具,需要很多帮助。

ARC Prize 2026提供200万美元的奖金,分布在三个竞赛轨道上,全部在Kaggle上举办。每个获胜的解决方案必须开源。时钟在滴答作响,而现在,机器甚至还没有接近。

本网站所有区块链相关数据与资料仅供用户学习及研究之用,不构成任何投资建议。转载请注明出处:https://www.lianxinshe666.com/2026/03/27/agi%e7%9c%9f%e7%9a%84%e6%9d%a5%e4%ba%86%e5%90%97%ef%bc%9f%e6%96%b0ai%e5%9f%ba%e5%87%86%e6%b5%8b%e8%af%95%e6%98%be%e7%a4%ba%ef%bc%9a%e8%bf%98%e5%b7%ae%e5%be%97%e8%bf%9c/