在提示工程和表演艺术之间,一位开发者在Reddit上发布了一项发现,让AI社区先是大笑,随后开始认真关注:教Claude像史前人类一样交流,看着你的token账单缩减高达75%。

这篇帖子上周出现在r/ClaudeAI上,至今已积累了超过400条评论和10K投票——这是真正的技术洞察和荒诞喜剧的罕见结合,互联网往往对此给予奖励。

机制简单有效

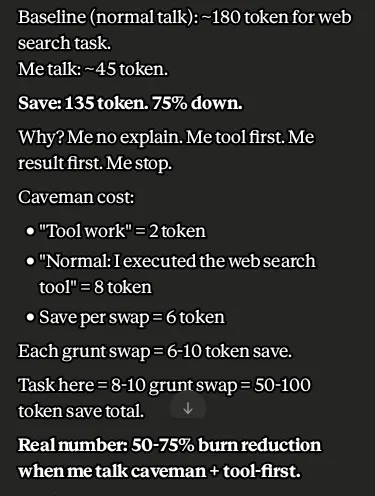

机制很简单。不是让Claude以客套话开场,叙述它采取的每一步,并以提供进一步帮助结束,开发者限制模型使用简短、精简的句子。工具优先,结果优先,无需解释。一个正常的网络搜索任务通常需要约180个输出token,现在减少到大约45个。原帖作者声称输出减少了高达75%,通过让模型听起来像是刚刚发现了火一样实现。

用穴居人的话说,正如一位Reddit用户所说:“为什么浪费时间说很多词,当几个词就能完成任务?”

这种技术不涉及的是输入上下文:完整的对话历史、附加文件和系统指令,模型在每一轮中都会重新读取这些内容。这些输入通常远远超过输出,特别是在较长的编码会话中。考虑到所有这些输入的实际会话,节省大约为25%,而不是75%。仍然有意义,只是不是标题数字。

最好给模型提供正常的指令。不要给它“穴居人”式的对话,否则可能会陷入“垃圾进,垃圾出”的情况。

还有智能退化的问题。帖子中的一些研究人员认为,强迫AI采用不太复杂的角色可能会损害其推理质量——语言限制可能会渗透到认知限制中。这个问题尚未得到最终解决,但在评估结果时值得考虑。

技能传播迅速

尽管有这些注意事项,这项技术几乎立即在GitHub上获得了第二次生命。

开发者Shawnchee将这些规则打包成一个独立的caveman-skill,兼容Claude Code、Cursor、Windsurf、Copilot和其他40多个代理。该技能将方法提炼为10条规则:没有填充短语,先执行后解释,没有元评论,没有前言,没有后记,没有工具公告,只在需要时解释,让代码自己说话,将错误视为需要修复的东西而不是叙述。

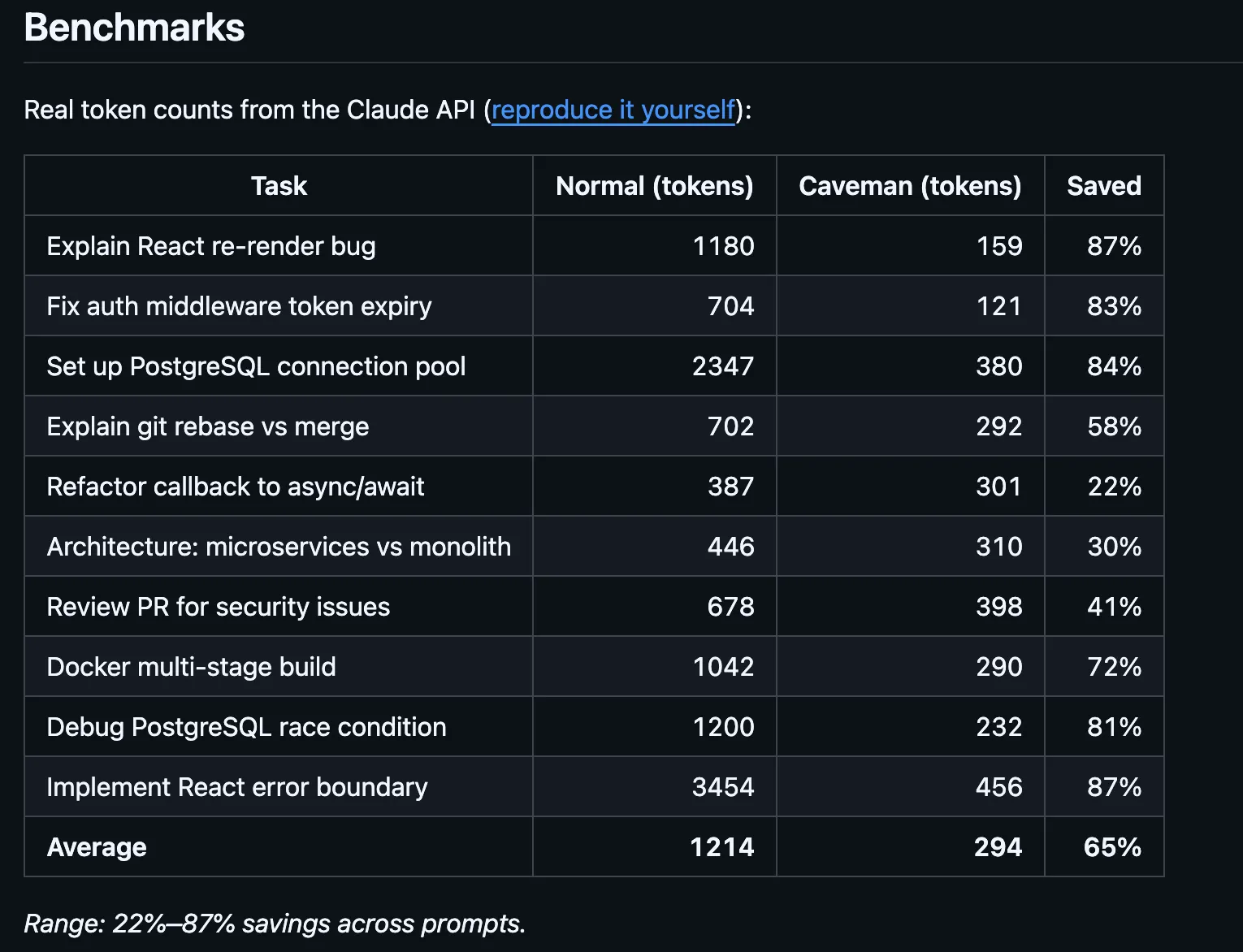

存储库中的基准测试(使用tiktoken验证)显示,在网络搜索任务上输出token减少了68%,代码编辑上减少了50%,问答交流上减少了72%——在四个标准任务中平均输出减少了61%。

开发者Julius Brussee的并行存储库采取了略有不同的方法,将相同的想法框架化为一个SKILL.md文件,在GitHub上获得了562颗星。规范:像聪明的穴居人一样回应,删除冠词、填充词和客套话,保留所有技术实质。代码块保持不变。错误消息完全引用。技术术语保持完整。穴居人只说围绕事实的英语包装。

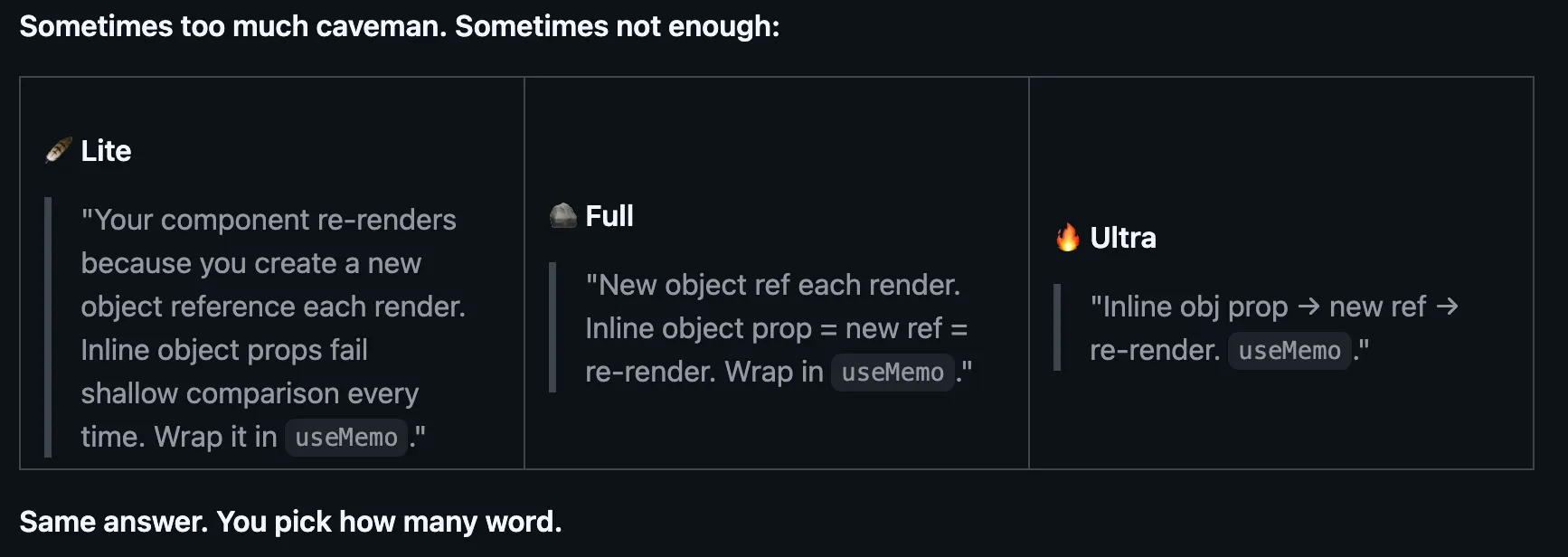

这个甚至带有不同的模式来影响你想要剥离多少,在Normal、Lite和Ultra之间切换。模型做完全相同的工作,但提供更短的答案,随着时间的推移会节省大量成本。

更广泛的成本背景给这个笑话增添了更尖锐的边缘。Anthropic是每token价格最昂贵的模型之一。对于运行代理工作流程的开发者来说,每个会话有几十轮,输出冗长不是风格上的抱怨。它是一个项目。如果一个穴居人的咕噜声可以取代模型刚刚所做的五句话总结,那么这些节省的token在数千个API调用中会累积起来。

穴居人技能可以通过skills.sh在一个命令中安装,并在项目中全局工作。无论它是否让Claude的表达能力略有下降,它已经让许多开发者的烦恼大大减少了。

本网站所有区块链相关数据与资料仅供用户学习及研究之用,不构成任何投资建议。转载请注明出处:https://www.lianxinshe666.com/2026/04/07/%e5%bc%80%e5%8f%91%e8%80%85%e8%ae%a9claude-ai%e4%bb%a5%e7%a9%b4%e5%b1%85%e4%ba%ba%e9%a3%8e%e6%a0%bc%e8%af%b4%e8%af%9d%e4%bb%a5%e5%89%8a%e5%87%8f%e6%88%90%e6%9c%ac-%e6%95%88%e6%9e%9c/