开发者Jackrong在Qwopus项目之后,推出了Gemopus——一个基于谷歌开源Gemma 4构建的Claude Opus风格微调模型家族,将前沿AI推理能力带入个人设备。

Gemopus模型家族

Gemopus家族包含两个版本:Gemopus-4-26B-A4B是较重选项,采用专家混合模型架构,拥有260亿总参数但推理时仅激活约40亿参数,在受限硬件上表现出色;Gemopus-4-E4B则是40亿参数的边缘模型,专为现代iPhone或轻薄MacBook设计,无需GPU即可运行。

技术基础与设计理念

谷歌Gemma 4于4月2日发布,直接基于与Gemini 3相同的研究和技术构建。这意味着Gemopus继承了谷歌最先进闭源模型的DNA,同时融合了Anthropic的思维风格。

Gemopus与其他Gemma微调模型的不同之处在于其设计哲学。Jackrong刻意避免将Claude的思维链推理痕迹强制注入Gemma权重中——这是大多数竞争版本采用的捷径。他认为,将教师模型的表面推理文本塞入学生模型并不能真正转移推理能力,只能教会模仿而非逻辑。

性能表现

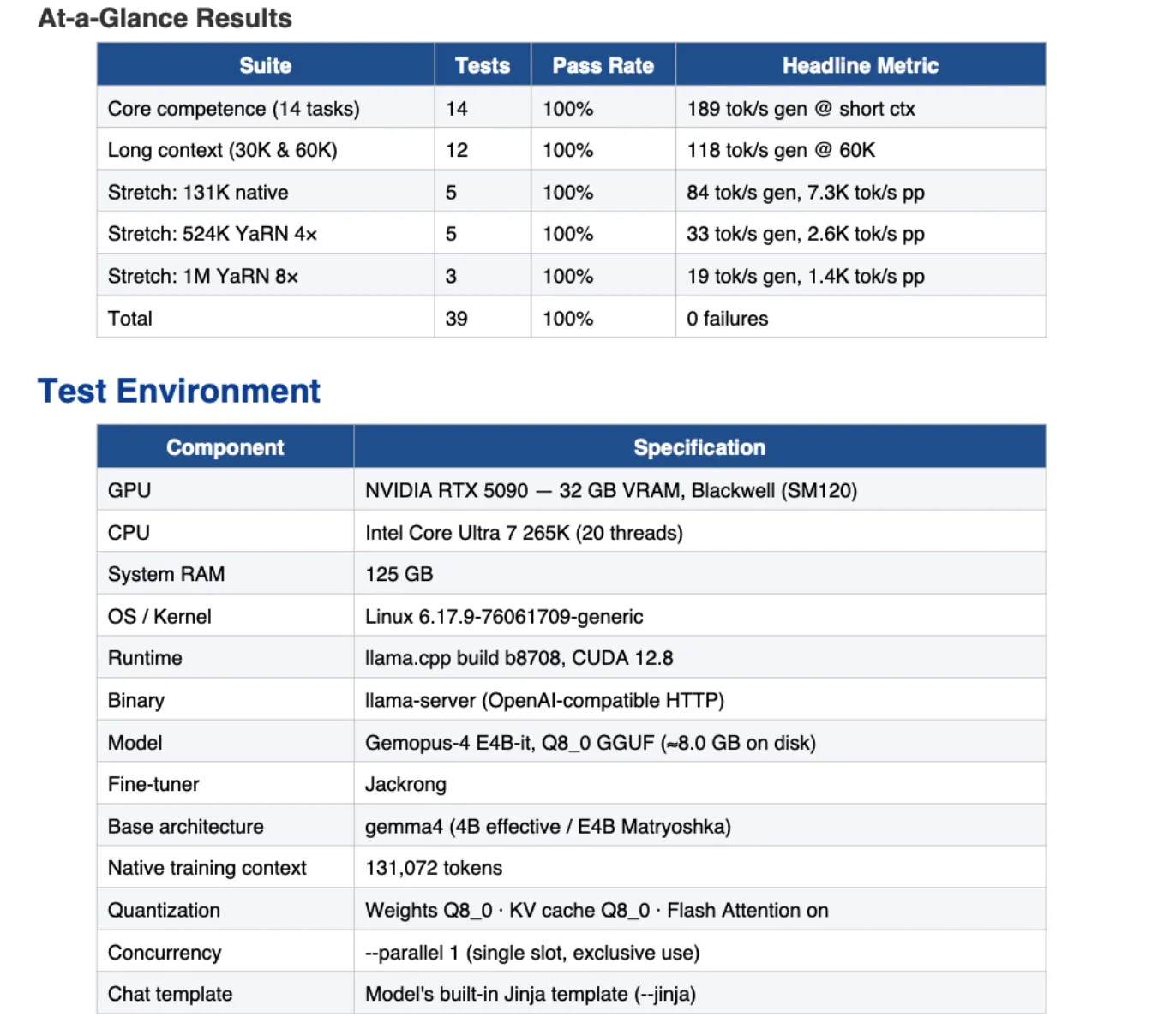

AI基础设施工程师Kyle Hessling进行了独立基准测试。他对26B变体的评价相当积极:“很高兴对这个模型进行了严格测试,它是对已经出色模型的优秀微调。在长上下文单次请求方面表现出色,并且由于MOE架构运行速度极快。”

较小的E4B变体通过了所有14项核心能力测试——指令遵循、编码、数学、多步推理、翻译、安全性、缓存——并在30K和60K令牌的所有12项长上下文测试中表现良好。在边缘硬件上,E4B速度确实很快:Jackrong报告在iPhone 17 Pro Max上达到45-60令牌/秒,在MacBook Air M3/M4上通过MLX达到90-120令牌/秒。

局限性

Gemopus并非完美无缺。在llama.cpp和LM Studio中,整个Gemma 4系列的工具调用功能仍然存在问题——调用失败、格式不匹配、循环等。Jackrong本人称其为“工程探索参考而非完全生产就绪的解决方案”,并推荐自己的Qwopus 3.5系列用于需要更稳定实际工作负载的用户。

由于Jackrong刻意避免激进的Claude风格思维链蒸馏,不要期望它像Qwopus那样具有深刻的Opus思维特性——这是为了稳定性而做出的有意权衡。

社区项目

对于那些希望深入研究Gemma推理微调的用户,还有一个值得关注的独立社区项目:由匿名开发者DJLougen创建的Ornstein,它采用相同的26B Gemma 4基础,专门专注于改进其推理链,而不依赖任何特定第三方模型的逻辑或风格。

一个诚实的注意事项:对于微调者来说,Gemma的训练动态比Qwen更混乱——损失波动更大,超参数敏感性更高。如果需要用于生产工作流程的更经过实战考验的本地模型,Jackrong的Qwopus 3.5系列仍然更稳健。但如果你想要具有Opus风格精度的美国模型,Gemopus目前是你最好的选择。

本网站所有区块链相关数据与资料仅供用户学习及研究之用,不构成任何投资建议。转载请注明出处:https://www.lianxinshe666.com/2026/04/15/%e8%b0%b7%e6%ad%8cgemma%e5%b7%b2%e5%85%b7%e5%a4%87gemini%e7%89%b9%e6%80%a7%ef%bc%8c%e5%bc%80%e5%8f%91%e8%80%85%e5%b0%86%e5%85%b6%e6%89%93%e9%80%a0%e6%88%90claude-opus%e9%a3%8e%e6%a0%bcgemopus%e6%a8%a1/